セミナーレポート

誰にでもわかる車載画像処理 ―車の周囲を見る技術・見せる技術―日産自動車(株) 下村 倫子

本記事は、画像センシング展2011にて開催された特別招待講演を記事化したものになります。

あえて境界線を残す

全方位カメラである「アラウンドビューモニター」をこれより紹介します。リアビューモニターのあとに「フロントビューモニター」というものが出ました。ブラインドコーナーからクルマのノーズだけ出して左右を確認したいというニーズに応えたものです。また,アメリカではこの考え方をバックビューに適用するシステムのニーズが非常に高いです。なぜなら,アメリカの駐車場ではクルマを頭から入れて後ろから出す場合が多いからです。

もう一つ見えづらいのは夜間です。夜の視覚支援はやはりニーズが高い。遠赤外線や近赤外線を照射して映像を出すシステムなど技術的にはいろいろあるのですが,一番問題なのはコストだと思っています。ここでは「そういうものがある」というだけにとどめておきます。

日産では,後方を表示するシステムを「バックビューモニター」,側方を表示するシステムを「サイドブラインドモニター」と呼んで商品化しています。バックビューモニターやサイドブラインドモニターは,当初,オプション品で出てきたものが,そのうちほとんどのクルマに付いてくるぐらいの勢いで増えました。クルマ用品店などで後付けで設置することも可能ですが,位置補正やハンドル連動ということを考えると,おそらく最初から付いていた方が使いやすいと思います。消費者のニーズを調査すると,最初はリアビューモニターが普及して,その後サイドビューや前後同時に見たいというニーズが出て来ています。こういう経緯があって,日産はアラウンドビューモニターを開発しました。

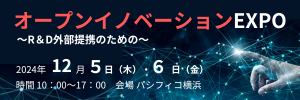

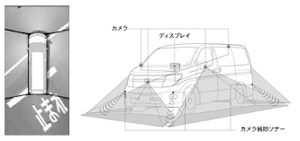

図1 全方位俯瞰(アラウンドビューモニター)

次に,アラウンドビューモニターの作り方を紹介したいと思います。4つのカメラはそれぞれ見下ろす方向に向けて付けています(図2)。得られた画像を変換することで,真上から見たような画像にしています。アラウンドビューモニターでは360度を,見やすい画像,理解しやすい画像として表示することが一番重要なことです。「理解しやすい表示で360度を見せてください」――これが私たち開発研究者に来た最初の要求です。4つのカメラで撮った画像を別々に見せることでも,「360度を見せる」というニーズには応えていることになります。しかし,「理解しやすい」というニーズには応えていません。4つの画像をつなげて俯瞰(ふかん)して,初めて瞬時に理解できる画像になると思います。

図2 全方位俯瞰(アラウンドビューモニター)。車両の前後左右に取り付けた4個の広角カメラから得た映像を、車両上方から見下ろした映像として表示

理解しやすい画像と,きれいな画像を作ることはちょっと違います。例えば,カメラの場所によっては日陰と日向(ひなた)の違いがあり,つないだ時にその境界でいきなり色が変わるケースがあります。先ほどのデジタルカメラの例では,一つの画像に統合するためにきれいにつなぐような処理をします。しかし,きれいにつなぐことによって場所に応じて生じている影が消えたりすることで,撮った画像がリアルなシーンではなくなってしまうことがあります。理解しやすいのはどちらかというと,やはりユーザーが見ている本物のシーンにできるだけ近いシーンです。そういうことで,オートゲインコントロールは一つ一つのカメラに任せています。また,境界線を無くしてしまうと画像のつなぎ目で急に色が変わってしまうことがあるので,あえて線を残しています。

ここで言いたかったのは,「きれいな画像は必ずしも運転者にとって理解しやすいものではない」ということです。重要なのは,運転者が使いやすいものです。技術と理解しやすいということは別の観点で議論されているために,このような紹介をしました。

<次ページへ続く>

日産自動車(株) 下村 倫子

1991年,東京農工大学 工学研究科 電子情報工学博士前期課程終了。1991年4月,日産自動車(株) 総合研究所電子情報研究所に入社。

現在,同社モビリティ研究室にて,運転支援に関する研究開発に従事(工学博士)。