セミナーレポート

誰にでもわかる車載画像処理 ―車の周囲を見る技術・見せる技術―日産自動車(株) 下村 倫子

本記事は、画像センシング展2011にて開催された特別招待講演を記事化したものになります。

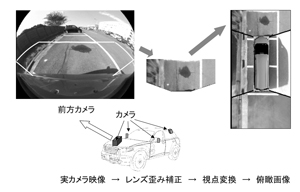

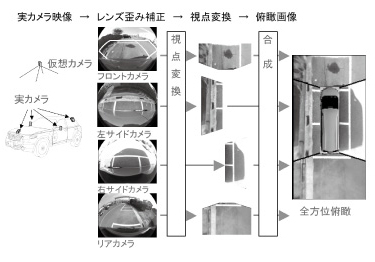

座標変換と歪み補正で合成

ここからは,撮影した画像からアラウンドビューモニターの画像をどうやって作るのか,ということを紹介します。まず,4つのカメラが撮影した画像がそれぞれあります。これらを合成して上から俯瞰した画像にしたい。仮想カメラがクルマの上空にあって,このカメラから見た映像を作りたいわけです。要するに,座標を変換したいということになります。カメラ座標系ではx,y軸が撮像面にあって,z軸方向に光軸があると仮定します。光軸はレンズの中央にあるので,光軸上にある物体は画像上では中央に映ります。仮想カメラで見た映像にしたい場合も,仮想カメラの光軸上にあるものは中央にあります。

図3 フロントカメラの例とアラウンドビューモニター

図4 全方位俯瞰画像の生成

<次ページへ続く>

日産自動車(株) 下村 倫子

1991年,東京農工大学 工学研究科 電子情報工学博士前期課程終了。1991年4月,日産自動車(株) 総合研究所電子情報研究所に入社。

現在,同社モビリティ研究室にて,運転支援に関する研究開発に従事(工学博士)。